Dunia teknologi baru saja menyaksikan titik balik penting. Google Research secara resmi memperkenalkan TurboQuant, sebuah algoritma kompresi memori AI ultra-efisien yang diumumkan pada Selasa lalu.

Tak butuh waktu lama bagi para netizen dan pakar teknologi di platform X (dahulu Twitter) untuk menyamakan penemuan ini dengan “Pied Piper”, startup legendaris dari serial TV HBO Silicon Valley.

Dikutip dari Techcrunch, Jumat (27/3/2026), jika Richard Hendricks menciptakan algoritma kompresi data yang mustahil, Google kini mewujudkannya di dunia nyata melalui optimalisasi memori kecerdasan buatan.

Persamaan ini bukan sekadar lelucon internet. Dalam serial tersebut, Pied Piper mampu mengecilkan ukuran file raksasa tanpa mengorbankan kualitas sedikit pun.

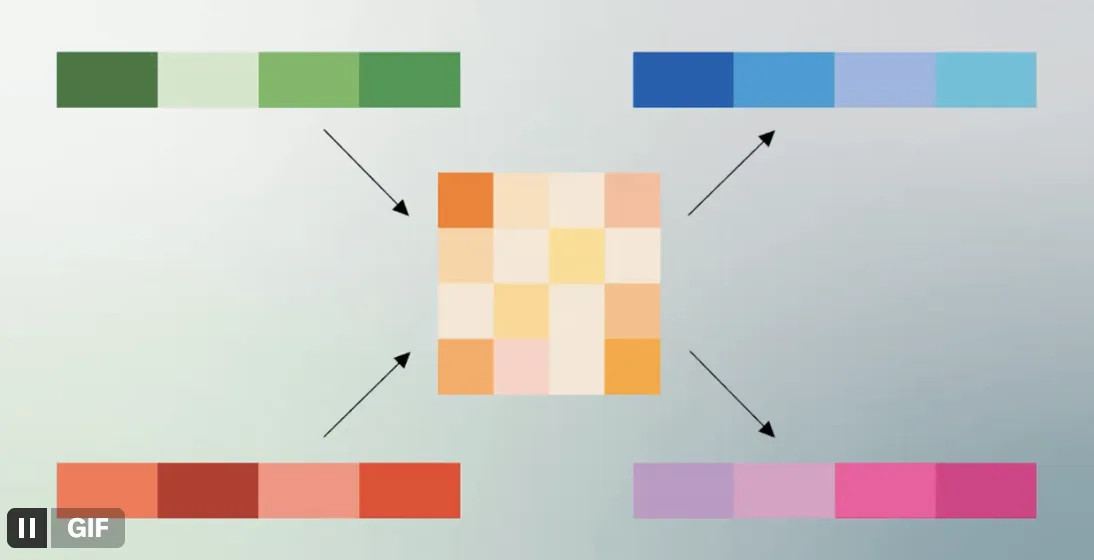

TurboQuant bekerja dengan filosofi serupa: melakukan kompresi ekstrem pada hambatan utama sistem AI, yaitu memori kerja, tanpa mendegradasi akurasi atau performa model sedikit pun.

Mengenal “The Golden Trio”: TurboQuant, PolarQuant, dan QJL

Bagi para peneliti AI, pengumuman ini adalah angin segar. Google tidak hanya merilis satu konsep, melainkan sebuah ekosistem efisiensi yang akan dipresentasikan di konferensi ICLR 2026 bulan depan. Rahasia di balik performa TurboQuant terletak pada dua pilar teknis utama:

- PolarQuant: Sebuah metode kuantisasi vektor yang memungkinkan representasi data dalam bentuk yang jauh lebih kecil namun tetap presisi tinggi.

- QJL (Quantized Johnson-Lindenstrauss): Metode pelatihan dan optimasi yang menjamin proses kompresi tetap stabil meskipun data dikurangi secara signifikan.

Dengan kombinasi ini, AI mampu “mengingat” lebih banyak konteks dalam percakapan yang panjang, namun hanya menggunakan ruang memori yang sangat terbatas. Ini adalah solusi atas masalah klasik AI saat ini: semakin pintar AI, semakin “rakus” ia akan memori RAM.

Dampak Industri: “DeepSeek Moment” Bagi Google

Gebrakan ini memicu reaksi dari berbagai pemimpin industri, termasuk CEO Cloudflare, Matthew Prince. Ia menyebut TurboQuant sebagai “DeepSeek Moment”-nya Google.

Sebagai konteks, DeepSeek (model AI asal Tiongkok) sempat mengguncang dominasi AS karena mampu mencapai performa setara GPT-4 dengan biaya pelatihan dan infrastruktur chip yang jauh lebih murah.

TurboQuant membawa misi serupa. Dengan mengurangi kebutuhan KV Cache (memori kerja saat AI memproses teks) hingga 6 kali lipat, biaya operasional AI di data center bisa dipangkas secara dramatis.

Ini berarti perusahaan tidak perlu lagi terus-menerus membeli chip GPU kelas atas yang harganya selangit hanya untuk menjalankan model AI yang cerdas.

“TurboQuant adalah jawaban atas kebuntuan skalabilitas hardware. Jika kita tidak bisa memperbanyak chip, maka kita harus memperpintar cara chip tersebut bekerja,” ujar Prince.

Realitas Laboratorium vs Implementasi Massal

Meskipun sangat menjanjikan, penting untuk dipahami bahwa TurboQuant saat ini masih berstatus terobosan laboratorium. Perbandingannya dengan Pied Piper atau DeepSeek memang menggairahkan, namun implementasi skala penuh di dunia nyata masih memerlukan waktu penyesuaian infrastruktur.

Satu catatan penting bagi para pengembang: TurboQuant saat ini difokuskan pada Memori Inferensi (memori yang digunakan saat AI memberikan jawaban), bukan pada Memori Pelatihan (saat AI belajar dari data mentah).

Artinya, meskipun AI akan menjadi lebih murah untuk digunakan oleh pengguna akhir, proses pembuatan model AI itu sendiri tetap akan membutuhkan kapasitas RAM dan daya komputasi yang sangat besar.

Namun demikian, TurboQuant adalah bukti bahwa efisiensi perangkat lunak bisa menjadi solusi saat perangkat keras mencapai batasnya. Ini bukan sekadar tentang mengecilkan data, ini tentang mendemokratisasi AI agar bisa berjalan lebih cepat, lebih murah, dan lebih hijau bagi bumi.

Scr/Mashable